Google I/O 2024: scopri tutte le novità e gli annunci

Al Google I/O 2024 sono state presentate tantissime novità per quanto riguarda Gemini e l'intelligenza artificiale. Scoprile tutte in questo articolo

Novità e annunci Google I/O 2024

Si è da poco conclusa l'attesissima conferenza Google I/O 2024, che ovviamente è stata quasi completamente incentrata sulle novità di Big G in fatto di intelligenza artificiale.

Durante l'evento, infatti, l’azienda di Mountain View ha presentato tantissime novità per tutti i suoi i servizi come Foto, Workspace e Search.

Ma le novità annunciate sono veramente tantissime, quindi andiamo a scoprirle insieme nel dettaglio.

Google I/O 2024: gli annunci più importanti

> Chiedi a Foto

Per molti utenti spesso risulta difficile trovare la foto precisa di cui hanno bisogno in un dato momento.

Utilizzando la nuova funzione Chiedi a Foto è possibile chiedere all'Ai Gemini di effettuare una ricerca per trovare il risultato giusto.

Per capirci, se vuoi cercare le migliori foto dei parchi nazionali che hai visitato, ti basterà chiedere in modo del tutto naturale “Mostrami le migliori foto di ogni parco nazionale che ho visitato“.

Grazie alle capacità multimodali di Gemini sarà possibile ottenere risultati pertinenti anche quando le foto sono prive di alcune informazioni.

L’intelligenza artificiale è infatti in grado di comprendere il contesto e il soggetto delle foto per estrarne i dettagli.

Inoltre sarà Gemini può creare in completa autonomia un album delle nostre vacanze, o di altri eventi, selezionando solo le foto migliori, così da mostrarci solo quello che vale la pena di essere viste.

> AI generativa in Ricerca Google

Con la funzione AI Overviews la ricerca su Google diventa ancora più smart, semplice e completa.

Questa funzione in pratica mostra risposte complete generate dall'AI in cima ai risultati di ricerca per la maggior parte delle query e fornisce una rapida panoramica di un argomento con collegamenti utili per eventualmente approfondire.

In questo modo la ricerca diventa più smart e quindi gli utenti non dovranno più suddividere la propria ricerca in più domande.

In altri termini, ora possiamo porre domande complesse senza il timore di mandare in tilt il motore di ricerca.

Iscrivendosi a Search Labs, gli utenti possono accedere a funzionalità ancora più avanzate basate sull'AI. Tra queste, la possibilità di semplificare il linguaggio in Panoramica IA, approfondire argomenti complessi o porre domande maggiormente articolate in un'unica ricerca, ottenendo risposte esaustive su una singola pagina.

Altra novità particolarmente interessante riguarda la possibilità di registrare un video per chiedere informazioni su qualsiasi cosa.

Grazie a Google Lens la ricerca con un video si traduce in tempo risparmiato: con un video, appunto, risulta ancora più semplice descrivere un problema e ottenere una panoramica con tutti i passaggi per risolverlo.

> Google Gemini pianificherà il nostro prossimo viaggio in un attimo

Tra i vari annunci, si è parlato anche di nuove funzionalità per l'organizzazione di viaggi.

L'aspetto interessante è che l'IA potrà accedere anche a delle informazioni più specifiche e personali (come l'orario di un volo o una prenotazione di un hotel tramite Gmail) per creare un itinerario di viaggio personalizzato che tiene conto anche delle tempistiche per gli spostamenti.

Il risultato sarà disponibile in pochi secondi e potrà essere modificato da ulteriori richieste, con l'itinerario che si aggiornerà automaticamente.

Un esempio suggerito da Google potrebbe essere: ''Io e la mia famiglia andremo a Miami per il Labor Day. Mio figlio ama l'arte e mio marito vorrebbe mangiare del pesce fresco. Puoi estrarre le informazioni su volo e hotel da Gmail e aiutarmi a pianificare il fine settimana?".

Gemini realizzerà un itinerario basandosi sulle informazioni ottenute dalle mail e utilizzerà Google Maps per trovare in questo caso sia ristoranti che luoghi artistici.

Gemini filtrerà i risultati anche in base a delle eventuali richieste specifiche, come per esempio dei cibi da evitare.

Queste nuove funzionalità saranno disponibile su Gemini Advanced nel corso dei prossimi mesi.

> Novità per i creator, tra cui Veo e Imagen 3

Veo è il modello più avanzato di Google per la creazione di video partendo da prompt testuali.

Può generare video in Full HD (1080p) con un’ampia gamma di stili cinematografici e visivi. La durata è di oltre un minuto.

Tra le novità di Veo spiccano la capacità di simulare la fisica del mondo reale in modo più realistico rispetto ai modelli precedenti e un rendering dei video ad alta definizione notevolmente migliorato.

La sfida a Sora di OpenAI è aperta!

Tra le altre novità c’è inoltre Imagen 3, un modello che genera immagini “con un incredibile livello di dettaglio” e con un numero di artefatti drasticamente ridotto rispetto alla versione precedente.

La vera sfida per Imagen 3 sarà il confronto con Dall-E 3 di OpenAI e altre soluzioni come Stable Diffusion, o Midjourney, in particolare nella gestione dei prompt testuali. Google afferma di aver migliorato la comprensione del testo e la capacità di elaborare dettagli anche in prompt più lunghi.

Anche per i musicisti ci sono dei nuovi tool AI, tutti inclusi nella suite chiamata Music AI Sandbox, una suite di strumenti che sfrutta l'intelligenza artificiale per facilitare la creazione di musica.

> Project Astra

Un’importante novità legata al futuro degli assistenti AI è Project Astra, una nuova applicazione mossa dall’intelligenza artificiale del colosso, o meglio, come lo definisce l’azienda, un “agente reattivo vedente e parlante avanzato”.

Nella pratica si tratta di un’applicazione che sfrutta la fotocamera dello smartphone e si presenta con un’interfaccia minimale, un semplice mirino che aiuta l’utente a capire cosa inquadrare con lo smartphone.

In realtà, fa molto di più.

Google ha mostrato in un trailer alcuni possibili vantaggi di poter sfruttare un'assistente AI con il "dono della vista".

Un agent, spiega l’azienda, deve essere in grado di capire e rispondere alla complessità e al dinamismo di ciò che circonda le persone, proprio come fanno le persone stesse.

Deve poi recepire e capire ciò che vede per comprendere il contesto e, di conseguenza, agire.

Infine, deve essere proattivo, istruibile e personale, perché l’utente deve poter comunicare con lui in modo naturale.

E cosa può fare Project Astra per noi?

Potenzialmente di tutto. Grazie alla funzionalità multi-modale, è capace di riconoscere il paesaggio fuori dalla finestra, risolvere una formula matematica, leggere e interpretare una parte di codice, riconoscere le parti di un altoparlante, inventarsi nomi simpatici per gli animali domestici.

Da notare, poi, l'incredibile interattività e proattività di Project Astra e la latenza quasi nulla.

Ma come funziona il nuovo agente di intelligenza artificiale?

Stando a quanto dichiarato dal CEO di DeepMind di Google, Demis Hassabis, l’assistente è “progettato per elaborare le informazioni più velocemente codificando continuamente fotogrammi video, combinando l’input video e vocale in una sequenza temporale di eventi e memorizzando queste informazioni nella cache per un richiamo efficiente”.

Project Astra è dunque un “agente di intelligenza artificiale universale” il cui scopo è essere utile nella vita di tutti i giorni.

Quando potremo provarlo?

Difficile dirlo, Google non fornisce informazioni precise al riguardo, ma si limita a dire che entro la fine dell’anno vedremo come queste funzionalità verranno implementate nei prodotti Google.

> Google svela Gemini 1.5 Flash e migliora 1.5 Pro: AI più veloce ed efficiente

Google ha presentato anche Gemini 1.5 Flash, un nuovo LLM della famiglia Gemini di intelligenza artificiale progettato per essere più veloce ed efficiente, con l'obiettivo di renderla più accessibile agli sviluppatori.

Nato per rispondere alle esigenze degli sviluppatori che necessitano di un modello AI più leggero e meno costoso rispetto a Gemini 1.5 Pro, Gemini 1.5 Flash sfrutta un processo chiamato "distillazione" per trasferire le conoscenze essenziali di Gemini 1.5 Pro al nuovo modello più piccolo.

"Gemini 1.5 Flash eccelle in attività come riassunti, conversazioni in chat, didascalie per immagini e video, estrazione di dati da documenti e tabelle lunghi e molto altro", spiega Demis Hassabis, CEO di Google DeepMind.

Nonostante la sua natura "light", Gemini 1.5 Flash mantiene la stessa potenza del modello Pro, ereditando le sue capacità multimodali e un'ampia finestra di contesto che gli permette di analizzare fino a un milione di token contemporaneamente (equivalenti a circa 1.500 pagine di un documento o 30.000 righe di codice).

Gemini 1.5 Flash, così come l'intera famiglia Gemini, non è pensato per gli utenti finali, bensì come strumento per gli sviluppatori che desiderano creare i propri prodotti e servizi di intelligenza artificiale utilizzando la tecnologia Google.

Oltre al lancio di Gemini 1.5 Flash, Google ha annunciato anche aggiornamenti per Gemini 1.5 Pro, migliorando le sue capacità di scrittura del codice, ragionamento e analisi di audio e immagini.

Entro la fine dell'anno la finestra di contesto del modello verrà raddoppiata a due milioni di token, permettendogli di elaborare due ore di video, 22 ore di audio, oltre 60.000 righe di codice o più di 1,4 milioni di parole contemporaneamente.

> L’AI di Google integrata sui dispositivi Android

Dopo il debutto sugli smartphone top di gamma di ultima generazione a marchio Samsung, da questo momento la funzione Cerchia e Cerca può essere utilizzata anche dagli studenti per svolgere i compiti.

«Immaginate che uno studente sia in difficoltà con un problema di matematica o fisica. Cerchiando il quesito, riceverà istruzioni dettagliate per risolverlo, senza abbandonare il programma o il foglio informativo digitale su cui sta lavorando», spiega Big G.

L’assistente mosso dall’intelligenza artificiale di google, Gemini, si appresta a ricevere alcuni miglioramenti per quel che concerne la comprensione del contesto di ciò che è sullo schermo, e quindi delle app in utilizzo sullo smartphone.

Presto sarà possibile utilizzare Gemini su qualsiasi schermata dello smartphone: potremo ad esempio trascinare e rilasciare le immagini generate in Gmail, Google Messaggi e altri luoghi oppure toccare “Chiedi a questo video” per trovare informazioni specifiche in un video di YouTube.

Entro la fine dell’anno Cerchia e cerca di Google diventerà ancora più potente e sarà in grado di aiutare a risolvere problemi ancora più complessi che coinvolgono formule simboliche, diagrammi, grafici e altro ancora.

Inoltre, gli utenti che dispongono di Gemini Advanced avranno anche a disposizione lo strumento “Chiedi a questo PDF” per ottenere rapidamente risposte senza dover scorrere più pagine.

> Gemini Nano

Grazie a Gemini Nano Google è in grado di offrire agli utenti Android esperienze rapide e mantenere le loro informazioni completamente private.

Entro la fine dell’anno l’azienda introdurrà sugli smartphone Pixel l’ultimo modello Gemini Nano con multimodalità, grazie al quale il nostro smartphone non solo sarà in grado di elaborare l’input di testo, ma anche di comprendere più informazioni in contesto come immagini, suoni e linguaggio parlato.

In Talkback, ad esempio, aiuterà le persone cieche o ipovedenti a ricevere descrizioni più chiare sul contenuto di una immagine.

Ma potrà anche avvisare l’utente in caso di frodi sospette durante le chiamate (rilevando ad esempio schemi di conversazioni comunemente associati a frodi).

Nello specifico, l’utente riceverà avvisi in tempo reale durante una chiamata se l’intelligenza artificiale rileva modelli di conversazione comunemente associati alle truffe, per esempio se un “rappresentante di banca” chiede di trasferire urgentemente fondi, effettuare un pagamento con una carta regalo o richiede informazioni personali come PIN o password della carta.

La funzionalità sarà disponibile entro la fine dell’anno e funzionerà localmente sul dispositivo, così da tutelare la privacy degli utenti.

> Gemini Live

Nei prossimi mesi gli abbonati a Gemini Advanced avranno accesso a Live, una nuova esperienza di conversazione mobile che, sfruttando la tecnologia vocale più avanzata dell’azienda, rende più intuitive le conversazioni con l’AI.

Sarà possibile parlare al proprio ritmo e anche interrompere per chiedere chiarimenti, proprio come si fa durante una conversazione normale con una persona reale e come fa il nuovo GPT-4o.

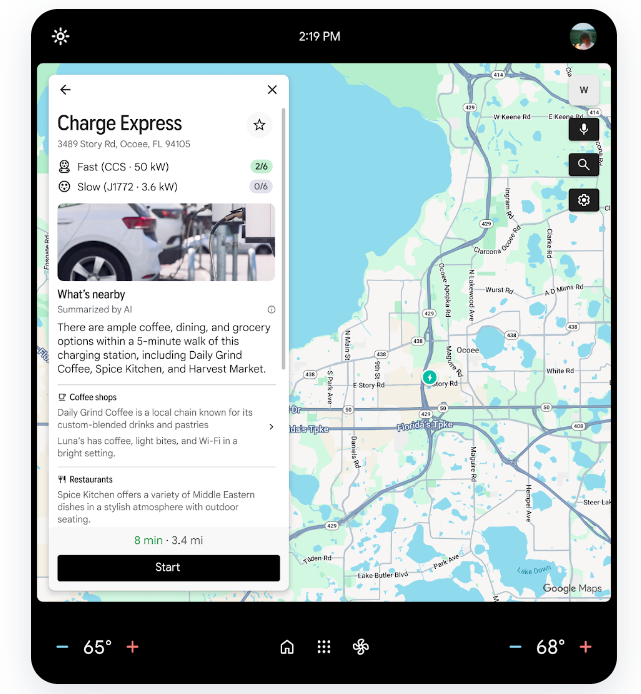

> Gemini migliorerà Google Maps su Android

Gli sviluppatori che usano i servizi di Google Maps (ossa l’API Places) per le loro applicazioni potranno fare affidamento su nuovi riassunti di luoghi e aree grazie all’intelligenza artificiale generativa.

Questo significa che chi userà tali applicazioni dovrebbe essere in grado di ottenere facilmente informazioni utili sui luoghi che cerca, come ad esempio i ristoranti, le attrazioni turistiche o gli alberghi.

Grazie a tale novità per le persone sarà più semplice e veloce trovare le informazioni che cercano nelle varie applicazioni, mentre la possibilità di avere approfondimenti e riepiloghi generati dall’IA eviterà agli sviluppatori di scrivere descrizioni personalizzate dei luoghi.

Ed ancora, grazie all’intelligenza artificiale e al modello Gemini, gli utenti potranno visualizzare panoramiche di negozi, ristoranti e attrazioni che si trovano a pochi passi da un luogo, in modo da poterli aiutare a valutare cosa fare una volta arrivati in una determinata località.

Infine, l’intelligenza artificiale potrà essere sfruttata per consentire agli utenti di comprendere più facilmente il motivo per il quale vedono determinati risultati di ricerca includendo più contesto.

Per esempio, cercando ristoranti “dog friendly“, sarà possibile visualizzare un elenco di locali pertinenti, insieme a recensioni e foto di cani nei ristoranti.

> Tre novità per Gmail grazie a Gemini

La prima novità è la possibilità di creare un riassunto della conversazione, una funzione molto utile per quei thread molto lunghi nei quali è davvero molto facile perdere il focus della discussione.

Il nuovo tasto che attiva la funzione viene mostrato appena sotto al soggetto della mail e permette di aprire una schermata di Gemini che mostrerà il riassunto dell’intera conversazione.

Gmail Q&A va oltre al semplice riassunto della conversazione, aprendo un prompt simile al pannello laterale della versione web, permettendo di porre domande all’IA.

L’ultima novità è costruita sulle fondamenta di Smart Reply e Smart Compose, unite per diventare Contextual Smart Replies.

La nuova funzione consente a Gmail di comprendere il contesto della mail e fornire suggerimenti maggiormente contestualizzati e dettagliati rispetto alle semplici proposte attuali.

La funzione mostrerà una serie di riquadri contenenti alcune proposte, in formato condensato, con la possibilità di visualizzare un’anteprima del suggerimento prima di inserirla nella mail di risposta.

Tra le tantissime novità legate all'intelligenza artificiale annunciate sul palco del Google I/O 2024, ci sono novità importanti per Chrome: l'IA sarà integrata direttamente all'interno del browser, con l'obiettivo di aiutare l'utente a scrivere alcuni contenuti, come ad esempio post sui social media o recensioni di prodotti sui shop online.

> Gemini Nano integrato in Chrome 126

Google includerà Gemini Nano già dalla prossima versione di Chrome (Chrome 126).

Gemini Nano è la versione più leggera del large language model di Google, che è stata ulteriormente alleggerita e ottimizzata per essere caricata rapidamente all'interno del browser.

A differenza di quanto avviene con Copilot, Gemini Nano girerà in locale e sarà parte integrante del browser.

Il modello verrà utilizzato anche per potenziare strumenti come “Aiutami a scrivere”, pensata per aiutare gli utenti a redigere email, recensioni e altro ancora. Grazie al LLM, questa funzione diventerà più veloce ed efficiente nel processo di analisi e generazione di contenuti.

Oltre a quella sopracitata, gli sviluppatori potranno sfruttare Gemini Nano per potenziare feature riguardanti la traduzione, la trascrizione e la creazione di sottotitoli.

Infine, Gemini sarà incluso anche nel DevTools per aiutare i developer a interpretare i messaggi d'errore del browser e fixare i bug.

> Google, ecco Gameface: il progetto per controllare il mouse con il viso

Si tratta di un sistema che va a sostituire il mouse con controlli gestiti attraverso espressioni facciali.

Per gli sviluppatori sarà possibile abbinare determinati comportamenti del puntatore con movimenti del viso. Per esempio, l’apertura della bocca potrebbe essere interpretato come un input utile a spostare il mouse, oppure un’alzata delle sopracciglia potrebbe essere tradotto in un clic.

Questo sistema si baserà sull’utilizzo di una telecamera, accompagnato da un database di espressioni facciali. Infine verrà utilizzata l’API Face Landmarks Detection di MediaPipe per tradurre il tutto in movimenti del sensore.

Come è facile intuire, Gameface rappresenta una piccola rivoluzione nel contesto di utenti con gravi disabilità.

Gameface mira a creare sistemi di controllo alternativi ma che, allo stesso tempo, permettano a chi ha problemi motori non solo di utilizzare un PC ma persino giocare con lo stesso.

La compagnia di Mountain View ha spiegato come gli sviluppatori saranno in grado di creare applicazioni personalizzate, andando a creare e abbinare diverse espressioni facciali, creando sistemi specifici in grado di soddisfare qualunque tipo di utente.

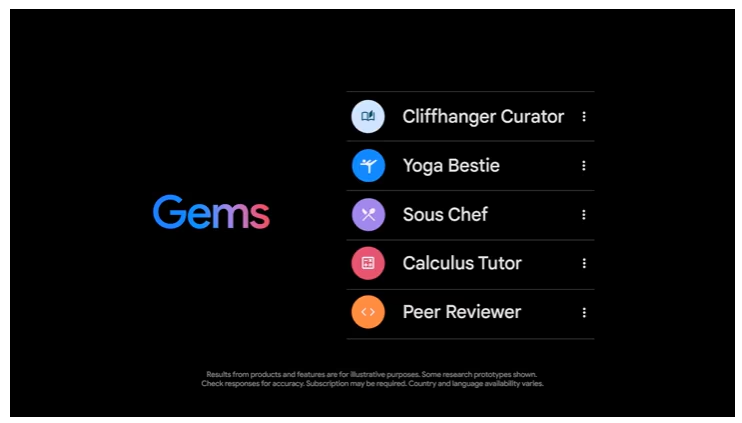

> Tutti potranno avere il proprio Gemini personalizzato

Il chatbot AI di Google è più sviluppato che mai e ora permette anche di creare delle sue versioni personalizzate.

La novità della quale stiamo parlando si chiama Gems, che dalle nostre parti potrebbe arrivare come Gemme.

Le Gemme sarebbero appunto le versioni personalizzate di Gemini che dovrebbero poter creare i suoi utenti.

Per versioni personalizzate si intende delle declinazioni di Gemini che tengano conto delle preferenze personali in ogni contesto, con la possibilità di tracciare le attività dell'utente per profilare al meglio la versione personalizzata di Gemini.

Queste Gemme permetteranno agli utenti di parlare con versioni di Gemini esclusive, generate a partire dal proprio profilo personale.

Google cita esplicitamente la possibilità di rendere Gemini, ad esempio, il proprio compagno di palestra, sous-chef, partner di programmazione, guida alla scrittura creativa o qualsiasi altra cosa.

Le Gemme di Gemini appaiono quindi molto simili a GPT Store, che permette appunto di creare delle versioni personalizzate di ChatGPT.

La novità Gems per Gemini verrà distribuita automaticamente per tutti coloro che sono abbonati a Gemini Advanced entro i prossimi mesi.

👉 Iscriviti al canale WhatsApp di YourLifeUpdated

Ricevi solo le notizie e le guide più importanti, senza spam.

Hai bisogno di aiuto o consigli rapidi?

💬 Supporto diretto: entra nel gruppo Telegram – CLICCA QUI

👥 In alternativa, unisciti al nostro Gruppo Facebook

🔥 Le migliori offerte tech, ogni giorno

💰 Unisciti al gruppo OFFERTE TECH (oltre 16.000 utenti)

Seleziono solo offerte davvero convenienti per farti risparmiare tempo e denaro.

Seguici anche qui:

📰 Google News o Facebook – per non perdere nessuna novità

🎥 YouTube – recensioni oneste, test e guide pratiche

💡 Vuoi risparmiare su Amazon?

🚀 Prova Amazon Prime gratis oppure

🛒 scopri le migliori offerte Amazon di oggi